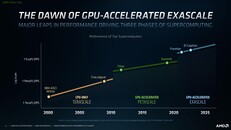

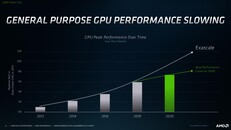

AMD a annoncé le lancement du Instinct MI100, basé sur la nouvelle architecture CDNA, destiné à l'apprentissage machine (ML) et aux charges de travail du calcul haute performance (HPC). Le MI100 devrait offrir 10 téraflops de performance FP64, allant jusqu'à 11,5 TFLOPS lorsqu'il est couplé avec des processeurs AMD EPYC de deuxième génération.

Au cours de la présentation, AMD a également confirmé que les processeurs EPYC de troisième génération basés sur le code Zen 3 de Milan sont maintenant échantillonnés pour sélectionner les OEM et sont prévus pour un lancement au premier trimestre 2021.

AMD a déclaré qu'elle développait différentes architectures adaptées à des applications spécifiques avec un certain chevauchement. Alors que l'ARNR s'adressera aux jeux, l'ARNCD est davantage axé sur les applications de calcul et de HPC. Le MI100 d'Instinct offre une technologie de base de matrice qui permet des opérations matricielles de précision simples et mixtes telles que FP32, FP16, bFloat16, Int8 et Int4.

Le tissu Infinity de deuxième génération du MI100 est doté de 32 Go de mémoire HBM2 à 1,2 GHz, offrant une bande passante de 1,23 TB/s

Le tableau suivant illustre les spécifications du AMD Instinct MI100

| Conception | Pleine hauteur, double fente, 10,5 in. de long |

| Unités de calcul | 120 |

| Processeurs de flux | 7,680 |

| FP64 TFLOPs (Peak) | 11.5 |

| FP32 TFLOPs (Peak) | 23.1 |

| Matrice FP32 TFLOPs (Peak) | 46.1 |

| Matrice FP16/FP16 TFLOPs (Peak) | 184.6 |

| Int4/Int8 TOPS (Peak) | 184.6 |

| bFLOAT16 TFLOPs (Peak) | 92.3 |

| Mémoire du CEC HBM2 | 32 GB |

| Interface mémoire | 4 096 bits |

| Horloge mémoire | 1.2 GHz |

| Bande passante de la mémoire | 1.23 TB/s |

| Support PCIe | Gen4 |

| Liaisons de tissus à l'infini/Bande passante | 3 / 276 GB/s |

| TDP | 300 W |

| Refroidissement | Refroidissement passif |

Bien que le MI100 soit conçu pour fonctionner avec les processeurs EPYC, AMD a confirmé que le nouveau GPU supporte également les processeurs Intel. Dans l'ensemble, on peut s'attendre à des performances jusqu'à 7x le FP16 du MI100 par rapport aux GPU HPC d'AMD de la génération précédente.

L'Instinct MI100 fournit jusqu'à 64 Go/s de bande passante Infinity Fabric entre le CPU et le GPU sans qu'il soit nécessaire d'utiliser des commutateurs PCIe. Il existe au total trois liaisons Infinity Fabric qui offrent un débit allant jusqu'à 276 Go/s. Essentiellement, une ruche quadruple-GPU du MI100 peut donner jusqu'à 1,1 To/s de bande passante totale. Selon AMD, ces caractéristiques donnent au MI100 des avantages significatifs par rapport au NVIDIA A100 dans les charges FP16/FP32 tout en offrant des performances plus élevées par dollar (voir les diapositives ci-dessous).

Le MI100 d'Instinct prend en charge le nouvel écosystème ROCm 4.0, qu'AMD présente comme une solution complète d'exascale pour les charges de travail ML et HPC. ROCm 4.0 utilise désormais un compilateur open source et supporte OpenMP 5.0 et HIP. En outre, PyTorch et TensorFlow sont maintenant optimisés pour ROCm 4.0.

On peut s'attendre à ce que l'AMD Instinct MI100 soit utilisé à la fin de l'année dans les principaux systèmes OEM et ODM de Dell, Gigabyte, HP et SuperMicro.

Top 10

» Le Top 10 des PC portables multimédia

» Le Top 10 des PC portables de jeu

» Le Top 10 des PC portables de jeu légers

» Le Top 10 des ordinateurs portables bureautiques

» Le Top 10 des PC portables bureautiques premium/professionnels

» Le Top 10 des Stations de travail mobiles

» Le Top 10 des Ultraportables

» Le Top 10 des Ultrabooks

» Le Top 10 des Convertibles

» Le Top 10 des Tablettes

» Le Top 10 des Tablettes Windows

» Le Top 10 des Smartphones

» Le Top 10 des PC Portables á moins de 300 euros

» Le Top 10 des PC Portables á moins de 500 euros

» Le Top 25 des meilleurs écrans d'ordinateurs

Voici quelques-unes des diapositives du point de presse d'AMD

Source(s)

Communiqué de presse AMD