L'Acer Swift Go 16 AI, doté de 16 Go de RAM et d'un AMD Ryzen 7 350, a récemment fait l'objet de nos tests. L'ajout du terme "AI" dans son nom suggère que cet ordinateur portable est prêt pour les applications d'intelligence artificielle. Notre analysesuggère cependant que la mémoire pourrait être plutôt sous-dimensionnée pour cette utilisation. Néanmoins, les modèles de langage, les générateurs d'images et les outils vidéo deviennent de plus en plus puissants et nécessitent toujours moins de mémoire vive. Sur le papier, certains modèles d'IA intéressants pourraient fonctionner sur la mémoire de l'ordinateur portable. Nous les avons mis à l'épreuve.

La dernière version de Windows 11 comprend déjà plusieurs outils d'IA, dont certains fonctionnent localement et d'autres sur les serveurs de Microsoft. Malheureusement, il n'est pas toujours évident de savoir d'où Copilot et d'autres tirent leur puissance de calcul. L'application Copilot nécessite systématiquement une connexion internet active. Certaines fonctions de l'application Photos fonctionnent localement sans connexion internet, tandis que d'autres nécessitent un compte Microsoft et ne fonctionnent pas hors ligne. Les améliorations de la qualité de l'image et de l'audio à partir des enregistrements de la webcam sont gérées localement par le NPU (Neural Processing Unit). La fonction de rappel de Microsoft a également été réintroduite, ce qui a suscité une certaine controverse. Toutefois, elle reste désactivée par défaut et ne peut être utilisée que lorsque le chiffrement de l'appareil et la protection par mot de passe sont activés. De nombreuses autres fonctions d'IA dans Windows ne sont pas particulièrement visibles ou ne fonctionnent qu'avec Microsoft Office.

Pour utiliser localement des modèles de langage alternatifs et des outils de génération d'images, vous avez besoin d'un logiciel spécifique. Toutefois, le processus d'exécution de ces programmes sur votre ordinateur personnel n'est plus aussi fastidieux qu'il y a un an. Il existe aujourd'hui des logiciels simples pour ces deux types d'outils, qui s'installent rapidement et offrent de nombreuses possibilités à l'utilisateur. Amuse propose un logiciel pour la génération et l'édition d'images AI, spécialement conçu pour le matériel AMD de l'Acer Swift Go 16 AI. LM Studio permet d'utiliser confortablement les SLM (small language models), c'est-à-dire les IA pour la génération de texte. FastFlowLM n'est pas aussi confortable à utiliser, mais il fonctionne de manière plus économe en énergie sur le NPU. Nous avons installé les trois programmes sur notre appareil de test. Cependant, l'Acer Swift Go 16 AI que nous avons utilisé n'est malheureusement pas équipé de manière optimale avec seulement 16 Go de mémoire. Windows et les programmes Acer préinstallés consomment rapidement six à neuf gigaoctets de la mémoire limitée. Il reste donc environ 10 Go de mémoire disponible pour l'IA. Amuse détermine qu'environ 8 Go de mémoire sont utilisables. LM Studio estime qu'elle est de 15 Go, mais se plante dès que nous essayons de charger un modèle de langage suffisamment grand.

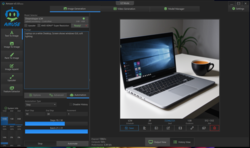

AMUSE - Édition et génération d'images par l'IA

Nous avons utilisé Amuse dans sa dernière version au moment du test (3.1). Le logiciel est gratuit et s'installe facilement. Le NPU du processeur AMD est pris en charge ici, ce qui devrait sensiblement accélérer le travail avec l'IA, même sans GPU dédié. Outre la génération de texte à partir d'images, le logiciel offre également des fonctionnalités de conversion d'images en vidéos et d'images en images.

Pour générer des images, vous devez d'abord installer Amuse, puis charger les modèles appropriés. Cette opération s'effectue à l'aide du programme, ce qui est relativement simple mais prend du temps car chaque modèle contient plusieurs gigaoctets de données. Parmi les trois préréglages proposés par Amuse en mode débutant, l'option "Balanced" ne nous convient pas. les modes "Rapide" et "Qualité", en revanche, fonctionnent, mais seul le mode rapide fonctionne vraiment sans problème. Le mode "Fast" repose sur le petit Dreamshaper LCM Turbo. Il tient bien dans la mémoire limitée de l'ordinateur portable et fonctionne très rapidement. Les images sont générées en quelques secondes. En mode expert, StableDiffusion XL Turbo et StableDiffusion 3 fonctionnent également. Ce dernier peut même être déchargé sur le NPU. Mais ces deux modèles utilisent pleinement la mémoire de l'ordinateur portable et ne fonctionnent pas vraiment rapidement. L'utilisation de la mémoire est particulièrement problématique lorsqu'Amuse est en cours d'exécution et que rien d'autre ne fonctionne correctement sur l'ordinateur portable. Dans les cas les plus graves, Amuse se bloque même si une fenêtre de navigation en arrière-plan demande trop de mémoire. Seule l'utilisation du petit Dreamshaper LCM est agréable. Pourtant, il produit des résultats relativement bons. Cependant, ses racines sont clairement visibles dans Stable Diffusion 1.5. Si vous ne prêtez pas attention aux invites, vous verrez beaucoup de bords flous et de proportions étranges. Mais Dreamshaper LCM est aussi incroyablement rapide. En un clin d'œil, ce modèle peut créer des images. Ici, la quantité prime sur la qualité. Une fois qu'une image est déjà raisonnablement acceptable. La qualité peut ensuite être améliorée dans Amuse grâce à l'édition image par image.

Top 10

» Le Top 10 des PC portables multimédia

» Le Top 10 des PC portables de jeu

» Le Top 10 des PC portables de jeu légers

» Le Top 10 des ordinateurs portables bureautiques

» Le Top 10 des PC portables bureautiques premium/professionnels

» Le Top 10 des Stations de travail mobiles

» Le Top 10 des Ultraportables

» Le Top 10 des Ultrabooks

» Le Top 10 des Convertibles

» Le Top 10 des Tablettes

» Le Top 10 des Tablettes Windows

» Le Top 10 des Smartphones

» Le Top 10 des PC Portables á moins de 300 euros

» Le Top 10 des PC Portables á moins de 500 euros

» Le Top 25 des meilleurs écrans d'ordinateurs

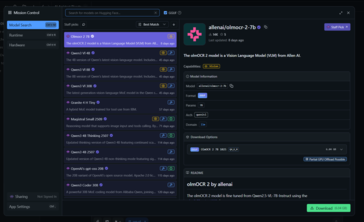

LM Studio - Chatbots, modèles de raisonnement et plus encore

LM Studio est un système de gestion et d'exécution de modèles linguistiques. Sur votre ordinateur portable, les dérivés de ChatGPT, Llama, Qwen3 et d'autres peuvent être exécutés localement. Comme pour Amuse, le facteur limitant de l'Acer Swift Go 16 AI semble être la maigre mémoire, plutôt que la puissance de traitement. Le nouveau gpt-oss 20B d'OpenAI se bloque au chargement en raison d'une mémoire insuffisante. Par expérience, nous pouvons confirmer que le modèle fonctionne parfaitement sur les ordinateurs portables équipés d'AMD Ryzen 9 370 et de 32 Go de mémoire.

Qwen3 Vi 8B, Qwen3 4B Thinking et Granite 4 H Tiny d'IBM (Q4_K_M et Q8_0) fonctionnent étonnamment bien sur l'ordinateur portable Acer. Le plus petit modèle linguistique d'IBM est remarquablement rapide et brille par ses réponses suffisantes. Qwen3 Vi 8B impressionne par le ton très naturel de son discours et démontre des qualités particulières dans le traitement des images. Pour les personnes ayant une vue réduite, une telle IA pourrait apporter une aide précieuse sur un ordinateur portable. Le modèle de raisonnement Qwen3 4B Thinking est le plus lent dans nos tests lorsqu'il s'agit de réponses purement textuelles. Mais ce sont surtout les réponses qui impressionnent. Selon la complexité de la question, il faut parfois jusqu'à cinq minutes pour recevoir une réponse de Qwen3. Bien entendu, vous pouvez observer le processus de réflexion et intervenir immédiatement si la réponse ne va pas du tout dans la bonne direction.

De nombreux autres modèles linguistiques plus petits devraient également fonctionner correctement sur notre appareil de test. Cependant, chaque modèle linguistique consomme également une quantité importante d'espace sur le disque SSD. Comptez entre 3 et 7 Go par modèle linguistique. Les petits SLM (Small Language Models) se révèlent étonnamment polyvalents.

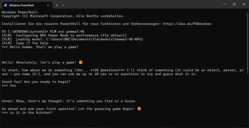

L'IA en mouvement - FastFlowLM avec prise en charge complète de l'AMD-NPU

Ceux qui utilisent LM Studio en voyage devront s'attendre à une batterie rapidement déchargée. LM Studio utilise à la fois le CPU et le GPU pour tous les calculs. Le NPU économe en énergie de notre Ryzen 7 350 n'a malheureusement pas été touché. FastFlowLM vous permet de profiter des performances du NPU de la puce AMD. Cela s'accompagne d'une consommation d'énergie nettement inférieure, bien que les LLM ne fonctionnent pas sensiblement plus lentement sur le NPU. La qualité des résultats reste inchangée. Cependant, FastFlowLM est légèrement plus difficile à utiliser que LM Studio, car il ne dispose pas de sa propre interface graphique. Une interface graphique pour FastFlowLM peut être obtenue via Open WebUI. Sinon, il est utilisé via Windows PowerShell. Bien que cela puisse être une expérience unique.

À titre de comparaison, nous avons mesuré la consommation d'énergie de l'ordinateur portable lors de l'utilisation de Gemma3:4b avec LM Studio et FastFlowLM. Avec FastFlowLM, la consommation maximale de l'ordinateur portable était d'environ 25 watts. La consommation d'énergie est nettement plus élevée lorsque le même modèle est utilisé avec LM Studio. Nous avons mesuré une consommation d'environ 65 watts. Dans les deux cas, le taux de sortie (en jetons par seconde) était nettement supérieur à 10 jetons/seconde. Selon la façon dont vous calculez, Gemma3:4b atteint environ 250 à 600 mots par minute avec 10 tok/s. En règle générale, 1,8 tokens correspond à un mot allemand, 1,3 tokens à un mot anglais. Nous avons analysé les textes allemands créés par Gemma et sommes arrivés à environ 450 mots par minute. Ce qui est beaucoup plus rapide que le lecteur typique.

Conclusion - L'IA locale est possible mais pas toujours utilisable

Les fonctions Windows AI fonctionnent parfaitement sur l'Acer Swift Go 16 AI. Étonnamment, les réponses des SLM comme Gemma3, Qwen3 et Granite 4 s'affichent rapidement à l'écran, mais avec une qualité variable selon le modèle et la tâche. Les personnes qui souhaitent vraiment utiliser les modèles Text2Image et d'autres fonctionnalités d'Amuse devraient probablement opter pour un ordinateur portable doté d'une plus grande mémoire. L'ordinateur Acer Swift Go 16 AI est également disponible avec 32 Go de RAM.

En fin de compte, l'IA n'en est qu'à ses débuts. Il n'existe pas encore de logiciels faciles à utiliser et exploitant les capacités du NPU d'AMD. C'est regrettable, car les performances que nous avons pu atteindre en bricolant un peu étaient particulièrement impressionnantes. Même Amuse montre un potentiel prometteur sur l'ordinateur portable, mais à notre goût, il génère trop de messages d'erreur et est parfois assez lent.

C'est ce que montrent principalement nos tests : Si vous voulez utiliser les fonctions d'IA de manière efficace, vous avez besoin de beaucoup de RAM rapide. La meilleure IA ne sert à rien si tous les autres programmes, comme Word et les navigateurs, se bloquent lors de l'utilisation des fonctions d'IA.