Les chercheurs d'Adobe ont démontré les progrès actuels de leur IA VideoGigaGAN pour améliorer les vidéos de faible qualité. Une fois entièrement développée, l'IA peut générer des vidéos de haute qualité sans avoir recours à des prises de vue coûteuses. Adobe améliore les travaux antérieurs en réduisant les artefacts et le scintillement tout en conservant les détails fins des vidéos traitées.

La technologie de mise à l'échelle et de super-résolution des images est utilisée depuis de nombreuses années pour améliorer la qualité et la résolution des images de mauvaise qualité. Certains appareils photo Sony Cybershot utilisent la technologie By Pixel Super Resolution pour mettre à l'échelle des images à faible résolution en utilisant une base de données d'images de référence, mais elle est limitée par les informations discrètes sur les pixels à une mise à l'échelle des images de deux à trois fois la taille d'origine. Plus récemment, Generative Adversarial Networks (GAN) entraînés sur des milliards d'images permettent de multiplier les images par 8 et plus.

L'application de ces techniques aux vidéos est difficile en raison de l'introduction d'aliasing et de stutter. Le lissage des détails de l'image peut éliminer ces problèmes en contrepartie d'une qualité moindre. VideoGigaGAN utilise plusieurs techniques pour contourner ces limitations, notamment le suivi du mouvement des objets, le flou de l'image, l'apprentissage des détails et le repeignage. Cependant, l'IA ne parvient pas à mettre à l'échelle des textes de petite taille ou des clips vidéo de longue durée, et des recherches supplémentaires sont donc nécessaires. En attendant, les lecteurs peuvent capturer des vidéos de haute qualité à l'aide d'un reflex numérique de premier ordre(comme celui-ci sur Amazon) afin d'éviter toute conversion inutile.

Détails techniques

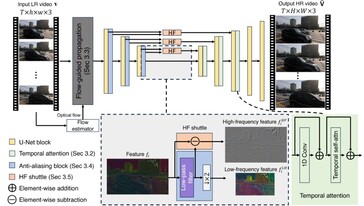

Pour maintenir un flux vidéo fluide entre les images au fil du temps, un module d'IA de propagation guidée par le flux est ajouté avant le GAN principal. Il "apprend" le mouvement des objets dans le temps dans l'entrée d'origine afin que le même mouvement fluide soit appliqué dans la vidéo mise à l'échelle. En outre, les couches de suréchantillonnage du GAN intègrent des couches d'attention temporelle qui contribuent à assurer la fluidité des transitions entre les images.

Pour résoudre le problème de l'aliasing, les images passent par un bloc anticrénelage au milieu du GAN, ce qui réduit malheureusement la qualité de l'image en raison de l'estompement des détails. Il en résulte une vidéo upscalée avec des mouvements fluides, sans aliasing, mais avec des détails d'image flous. VideoGigaGAN contourne ce problème en introduisant une navette à haute fréquence qui extrait les détails fins des couches initiales de sous-échantillonnage du GAN et les applique ultérieurement aux couches suréchantillonnées. Le résultat de plusieurs couches de traitement d'image est une vidéo de super-résolution qui contient un niveau de détail élevé sans aliasing ni scintillement.

Source(s)

Top 10

» Le Top 10 des PC portables multimédia

» Le Top 10 des PC portables de jeu

» Le Top 10 des PC portables de jeu légers

» Le Top 10 des ordinateurs portables bureautiques

» Le Top 10 des PC portables bureautiques premium/professionnels

» Le Top 10 des Stations de travail mobiles

» Le Top 10 des Ultraportables

» Le Top 10 des Ultrabooks

» Le Top 10 des Convertibles

» Le Top 10 des Tablettes

» Le Top 10 des Tablettes Windows

» Le Top 10 des Smartphones

» Le Top 10 des PC Portables á moins de 300 euros

» Le Top 10 des PC Portables á moins de 500 euros

» Le Top 25 des meilleurs écrans d'ordinateurs