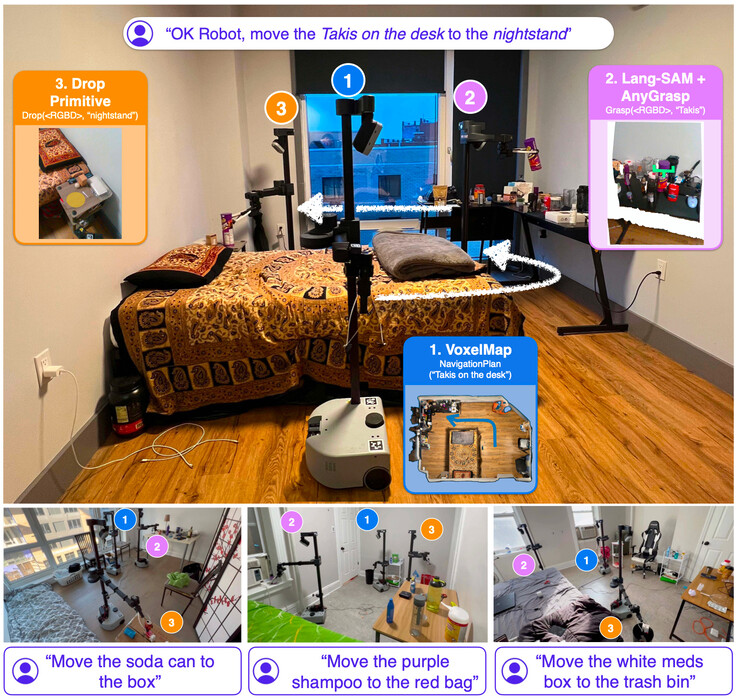

Le nouveau système OK-Robot Est conçu pour permettre à une grande variété de robots de ranger des pièces qu'ils ne connaissent pas du tout. Par exemple, ils peuvent ramasser du linge ou des jouets sur le sol et les placer ailleurs. Les autres systèmes robotiques sont généralement conçus pour fonctionner dans un environnement familier.

OK-Robot travaille avec des VLM (modèles vision-langage), un type de système d'intelligence artificielle capable de traiter et de comprendre des informations provenant de textes ou de discours directs et d'images en même temps. Il est également intéressant de noter qu'OK-Robot travaille avec une variété de logiciels modèles d'IA Et qu'il a été pré-entraîné avec de grands ensembles de données accessibles au public.

L'aspect positif est que vous n'avez pas besoin de donner au robot des données d'entraînement supplémentaires dans l'environnement, il fonctionne tout simplement. Côté négatif, il ne peut que ramasser un objet et le déposer ailleurs. Vous ne pouvez pas lui demander d'ouvrir un tiroir, car il ne sait faire que ces deux choses.

- Lerrel Pinto, professeur adjoint d'informatique à l'université de New York, qui a codirigé le projet

Top 10

» Le Top 10 des PC portables multimédia

» Le Top 10 des PC portables de jeu

» Le Top 10 des PC portables de jeu légers

» Le Top 10 des ordinateurs portables bureautiques

» Le Top 10 des PC portables bureautiques premium/professionnels

» Le Top 10 des Stations de travail mobiles

» Le Top 10 des Ultraportables

» Le Top 10 des Ultrabooks

» Le Top 10 des Convertibles

» Le Top 10 des Tablettes

» Le Top 10 des Tablettes Windows

» Le Top 10 des Smartphones

» Le Top 10 des PC Portables á moins de 300 euros

» Le Top 10 des PC Portables á moins de 500 euros

» Le Top 25 des meilleurs écrans d'ordinateurs

Le système a été testé par des chercheurs de l'Université de New York et de Meta en utilisant le robot commercial Stretch de Hello Robot. 171 expériences de ramassage et de dépôt ont été réalisées dans différentes maisons. Pendant les expériences, le robot a scanné l'environnement à l'aide de l'appareil Record3D iPhone pour créer une vidéo en 3D. Le système OK Robot a ensuite exécuté un modèle de reconnaissance d'objets IA sur chaque image de la vidéo.

Cela a permis au robot d'identifier tous les objets de son environnement, tels qu'une table, un canapé, une paire de lunettes, une chaussure et une lampe. Il lui a ensuite été demandé de ramasser certains objets, ce qu'il a fait dans 82,2 % des cas, à condition que la pièce ne soit pas trop encombrée encombrée. En revanche, dans les pièces plus chaotiques, le taux de réussite était nettement inférieur.

Je dirais qu'il est assez inhabituel de s'appuyer entièrement sur des modèles prêts à l'emploi et qu'il est assez impressionnant de les faire fonctionner. Nous avons assisté à une révolution dans le domaine de l'apprentissage automatique qui a permis de créer des modèles qui fonctionnent non seulement en laboratoire, mais aussi dans le monde extérieur. Voir que cela fonctionne dans un environnement physique réel est une information très utile.

- Matthias Minderer, chercheur principal en vision artificielle chez Google DeepMind, qui n'a pas participé au projet

Le système est encore loin d'être parfait ; par exemple, il a parfois des difficultés à comprendre les données vocales, et son modèle de préhension a également des problèmes avec certains objets. Néanmoins, le projet montre que les modèles actuels sont capables de s'adapter relativement bien à un vocabulaire ouvert et, en même temps, de naviguer directement vers les bons objets dans des espaces peu familiers.

Sources d'information

MIT Technology Review | VentureBeat | image teaser : image symbolique par DALL-E / AI | images 2,3 : arvix